La Unión Europea intensifica su ofensiva para proteger a los menores en internet

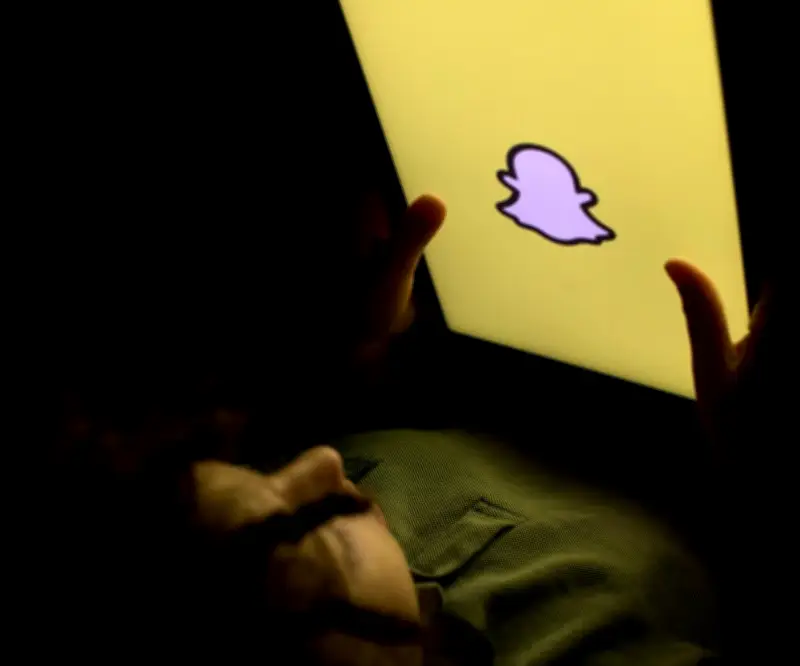

La Unión Europea ha puesto en la mira a la red social Snapchat y a varias plataformas de contenido pornográfico como parte de una campaña integral de protección infantil en el entorno digital. Este jueves 26 de marzo de 2026, el órgano ejecutivo de la UE anunció medidas concretas que podrían resultar en sanciones económicas significativas para las empresas investigadas.

Investigación exhaustiva sobre Snapchat

La investigación sobre Snapchat, propiedad de Snap Inc., se centrará específicamente en tres aspectos críticos de la seguridad infantil:

- Verificación de edad: Cómo la plataforma confirma la edad real de sus usuarios

- Protección contra acoso: Mecanismos para abordar el acoso y actividades delictivas dirigidas a menores

- Moderación de contenido: Eficacia en la eliminación de material que promueve drogas y otros artículos ilegales

Un portavoz de Snapchat confirmó que la empresa está cooperando plenamente con la comisión, trabajando de buena fe para cumplir con los altos estándares de seguridad establecidos por la Ley de Servicios Digitales (DSA).

Ampliación de la investigación a plataformas pornográficas

Paralelamente, la Comisión Europea ha decidido avanzar a una segunda fase de investigación sobre cuatro importantes plataformas de contenido para adultos: PornHub, Stripchat, Xnxx y XVideos. Esta decisión se produce después de que la comisión determinara preliminarmente que estas empresas habrían infringido la legislación europea al no implementar medidas efectivas para impedir el acceso de menores a sus sitios web.

Los representantes de estas plataformas pornográficas no respondieron de inmediato a las solicitudes de comentarios sobre las nuevas investigaciones.

Marco legal y posibles sanciones

Estas acciones se enmarcan dentro de la Ley de Servicios Digitales (DSA), la normativa europea sobre moderación de contenidos que entró en vigor en 2022. La DSA obliga a las plataformas en línea a cumplir con estándares estrictos de mitigación de riesgos y transparencia.

Las empresas investigadas tienen dos caminos posibles: comprometerse a abordar las quejas de la comisión o enfrentarse a multas que podrían alcanzar hasta el 6% de sus ventas globales anuales. Henna Virkkunen, vicepresidenta ejecutiva y máxima responsable de tecnología de la comisión, declaró durante una rueda de prensa que estas investigaciones envían un mensaje claro sobre la seriedad con que deben tomarse los riesgos en línea.

Contexto internacional y precedentes

Las medidas de la UE se producen en un momento de creciente presión global sobre las empresas tecnológicas. Recientemente, en Estados Unidos, un jurado ordenó a Meta Platforms Inc. y Alphabet Inc. pagar una indemnización a una joven de 20 años que alegó que su adicción a las redes sociales le había causado problemas de salud mental.

Desde la implementación de la DSA en 2022, la comisión ha abierto más de una docena de investigaciones sobre plataformas en línea. Hasta la fecha, solo una ha resultado en una multa significativa: en diciembre, X, la empresa de Elon Musk, fue sancionada con 120 millones de euros por diseño engañoso y falta de transparencia, decisión que generó críticas del gobierno estadounidense.

Avances en verificación de edad

Los organismos reguladores están intensificando sus esfuerzos en materia de verificación de edad como herramienta clave para proteger a los menores. Actualmente, una herramienta de verificación aprobada por la Comisión Europea se está probando en algunos países de la UE y está previsto que se implemente en todo el bloque este otoño.

Esta tendencia se extiende más allá de Europa. Apple Inc. anunció esta semana nuevos requisitos de verificación de edad para usuarios en el Reino Unido, que exigirán confirmar que tienen al menos 18 años para acceder a ciertas funciones de sus dispositivos y servicios.

La protección de los menores en el entorno digital se ha convertido en una prioridad absoluta para las autoridades europeas, que están dispuestas a utilizar todo el peso de la legislación comunitaria para garantizar que las plataformas en línea cumplan con sus responsabilidades en materia de seguridad infantil.