Identificando la huella digital de la inteligencia artificial en la escritura

En el panorama tecnológico actual de Colombia, diferenciar entre un texto producto de la reflexión humana y uno generado mediante procesos automatizados se ha convertido en un desafío creciente. La proliferación de herramientas como ChatGPT, Gemini, Perplexity y Claude ha democratizado la producción de contenido, permitiendo que en cuestión de segundos se generen ensayos académicos, informes empresariales e incluso artículos periodísticos con una coherencia estructural notable.

La complejidad de distinguir lo humano de lo artificial

Norberto Cristancho, director de Ingeniería Multimedia en UCompensar, explica que "reconocer si un texto ha sido escrito con inteligencia artificial cada vez es más difícil", aunque los modelos de lenguaje suelen dejar ciertas pistas identificables. Según el experto colombiano, la IA tiende a manifestar patrones específicos que pueden alertar sobre su origen no humano.

Patrones reveladores en la escritura automatizada

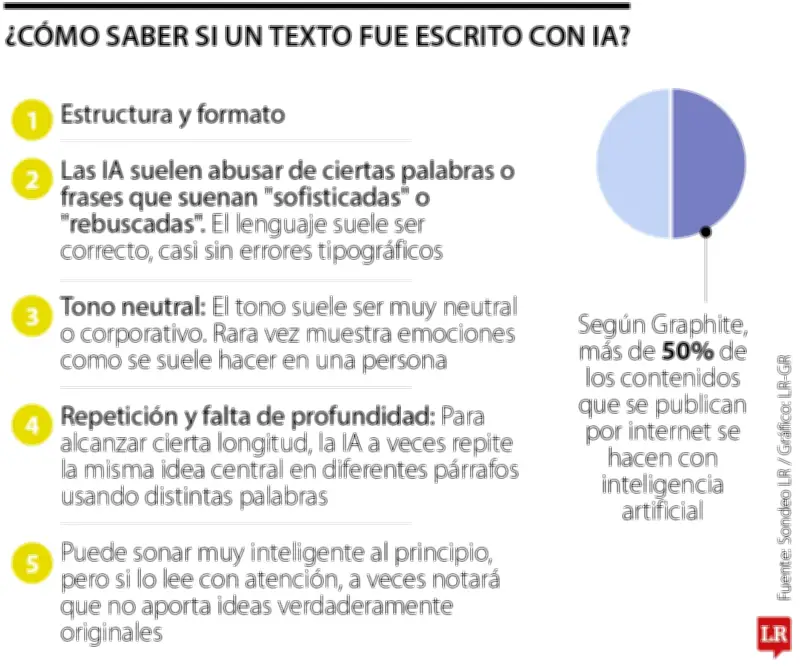

Los textos generados por inteligencia artificial presentan características distintivas:

- Estructura escolarizada: Suelen organizarse como ensayos académicos básicos, con introducción, desarrollo y conclusión claramente demarcados.

- Conectores formales recurrentes: Abundan expresiones como "En primer lugar", "Por otro lado", "En conclusión" o "Es importante destacar".

- Lenguaje excesivamente pulido: Presentan corrección gramatical casi perfecta, con mínimos errores tipográficos.

- Tono neutral y corporativo: Carecen de matices emocionales, opiniones personales o expresiones coloquiales.

- Repetición disfrazada: Para alcanzar extensiones específicas, reformulan la misma idea central en diferentes párrafos utilizando sinónimos.

Cristancho advierte que "puede sonar muy inteligente al principio, pero si lo lees con atención, a veces notas que no aporta ideas verdaderamente originales", destacando cómo la sofisticación superficial puede ocultar una falta de profundidad conceptual.

Limitaciones en las herramientas de detección

Luis Sánchez Urrrego, gerente de Operaciones y Tecnología Cloud & Datacenter en Sonda Colombia, profundiza en las dificultades técnicas para identificar contenidos generados por IA. "Los modelos más modernos generan contenidos claros, bien estructurados y muy naturales, que pueden parecer completamente humanos", explica el ejecutivo colombiano.

El experto detalla dos problemas principales en los sistemas de detección actuales:

- Falsos negativos: Ocurren cuando un texto creado con IA no es identificado como tal, debido a la creciente naturalidad en la generación automatizada.

- Falsos positivos: Suceden cuando escritos humanos son marcados erróneamente como generados por IA, especialmente cuando presentan redacciones estandarizadas, repetitivas o predecibles.

La incertidumbre persistente en la autoría textual

A pesar de los avances en identificación de patrones, la certeza absoluta sobre la autoría de un texto sigue siendo esquiva. La evolución constante de los modelos de lenguaje y su capacidad para emular estilos humanos complejos mantiene un margen de duda significativo. Esta situación plantea desafíos éticos y prácticos en ámbitos académicos, periodísticos y profesionales colombianos, donde la autenticidad del pensamiento humano conserva un valor fundamental.

La convivencia entre escritura humana y generación automatizada redefine constantemente los límites de la autoría, exigiendo tanto a creadores como a consumidores de contenido desarrollar una mirada más crítica y analítica frente a los textos que circulan en el ecosistema digital colombiano.