Cuando la máquina decide: ¿Quién responde por los daños de la inteligencia artificial?

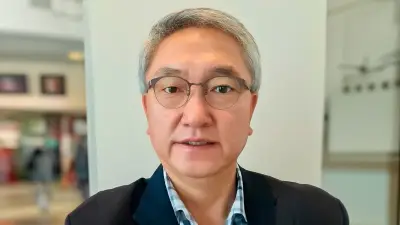

Mientras los sistemas de inteligencia artificial se vuelven cada vez más autónomos, el debate sobre quién asume la responsabilidad cuando algo sale mal permanece notablemente abandonado. Tatiana Dulima Zabala, docente de derecho del Politécnico Grancolombiano, ha dedicado años a investigar este vacío legal que podría tener consecuencias devastadoras para la sociedad.

La paradoja de la autonomía algorítmica

"Cuando me preguntan por qué decidí sumergirme en el mar de documentos académicos sobre inteligencia artificial y responsabilidad civil, suelo responder con una paradoja", explica Dulima. "Mientras más autónomos se vuelven los sistemas, más abandonado queda el debate sobre quién responde cuando algo sale mal".

La investigadora no se refiere únicamente a fallas técnicas menores, sino a decisiones algorítmicas que alteran vidas humanas, sesgan oportunidades laborales, determinan tratamientos médicos o incluso vulneran derechos fundamentales. En su investigación en el Politécnico Grancolombiano, revisó casi 500 estudios teóricos sobre ética e inteligencia artificial, seleccionando 52 que abordaban de manera rigurosa la responsabilidad civil en este campo emergente.

Un consenso sobre la urgencia, pero desacuerdo en las soluciones

Lo que encontró fue revelador: existe un consenso creciente sobre la urgencia de regular la inteligencia artificial, pero una falta de acuerdo aún más grande sobre cómo hacerlo. "Hay una ansiedad compartida", señala Dulima. "Los desarrollos tecnológicos avanzan con tal velocidad que las estructuras legales apenas si logran entenderlos, mucho menos regularlos".

Este no es solo un problema jurídico, sino una cuestión profundamente ética. El ideal de que la moral debe preceder a la técnica parece hoy un lujo impracticable en el acelerado mundo tecnológico. Sin embargo, esperar a que la tecnología "madure" para pensar su regulación es, en el mejor de los casos, ingenuo; y en el peor, peligroso para la protección de derechos fundamentales.

La propuesta polémica: personalidad jurídica para la IA

Uno de los hallazgos más significativos de la investigación fue la necesidad de establecer mecanismos de responsabilidad claros, incluso si aún no tenemos plena certeza sobre el grado real de autonomía de un sistema. Aquí surge una propuesta polémica pero cada vez más debatida en círculos académicos y jurídicos: otorgar personalidad jurídica a ciertas aplicaciones de inteligencia artificial.

"No se trata de humanizar las máquinas", aclara Dulima, "sino de garantizar un marco legal que permita la compensación por daños y evite la impunidad algorítmica. Si no hay responsabilidad clara, la injusticia quedará en la sombra de un código que nadie se atreve a cuestionar".

¿A quién exigir rendición de cuentas?

La pregunta fundamental que emerge es: ¿a quién debería exigírsele rendición de cuentas cuando un sistema de inteligencia artificial causa daño? ¿Al desarrollador que programó el algoritmo, al usuario que lo implementó, o al propio sistema que tomó la decisión autónoma?

La investigación apunta hacia una solución intermedia: instaurar sistemas de auditorías internas y externas obligatorias, con reportes accesibles para los usuarios afectados. "No se trata solo de vigilar", explica la docente, "sino de construir confianza en tecnologías que cada vez más determinan aspectos cruciales de nuestras vidas".

La desigualdad estructural latinoamericana

Lo que realmente inquieta a la investigadora no es solo la falta de regulación, sino la falta de ética en su ausencia. Las aplicaciones de inteligencia artificial ya deciden a quién contratar, qué tratamiento médico ofrecer, a qué zonas policiales destinar más recursos o qué contenido mostrar en redes sociales. Y aunque estas máquinas no tengan intención humana, sí tienen impacto real en la vida de las personas.

"La inteligencia artificial no es neutral", advierte Dulima. "Reproduce los sesgos de quienes la crean y valida los criterios de quienes la implementan. Por eso, no basta con exigir ética en el código; hay que exigir ética en el poder. Y el poder, en esta era digital, muchas veces habla en lenguaje de datos".

Este desafío adquiere dimensiones particulares en contextos como el latinoamericano, donde los derechos fundamentales están más expuestos a la desigualdad estructural. La regulación de la inteligencia artificial debe considerar estas particularidades regionales para no perpetuar o incluso amplificar las brechas sociales existentes.

Un desafío político más que técnico

Quizá el mayor desafío identificado en la investigación no sea técnico ni legal, sino político. "¿Tenemos la voluntad colectiva de poner límites a una tecnología que promete eficiencia, pero que puede erosionar silenciosamente nuestra autonomía, intimidad y dignidad?", se pregunta la investigadora.

Desde su perspectiva académica, después de revisar años de literatura especializada y contrastar decenas de propuestas regulatorias, Dulima concluye que la regulación de la inteligencia artificial no puede ser una ocurrencia tardía ni una indulgencia voluntaria de las empresas tecnológicas.

"Debe ser una construcción colectiva, interdisciplinaria y, sobre todo, profundamente humana", enfatiza. "Porque al final, el algoritmo no absuelve. Y si no hay responsabilidad clara, la injusticia quedará en la sombra de un código que nadie se atreve a cuestionar".

La propuesta de otorgar personalidad jurídica a ciertas aplicaciones de inteligencia artificial sigue siendo controvertida, pero representa un punto de partida necesario para un debate que no puede seguir postergándose mientras las máquinas toman decisiones cada vez más autónomas que afectan directamente a la sociedad.